Netflix zaprezentował VOID — nowy model do edycji wideo, który usuwa obiekty z kadru nie tylko na poziomie obrazu, ale również na poziomie logiki całej sceny. W przeciwieństwie do klasycznych narzędzi do video inpaintingu, które często jedynie „zamazują” miejsce po usuniętym elemencie, VOID próbuje pokazać, jak wyglądałoby nagranie, gdyby dany obiekt od początku w ogóle się w nim nie pojawił, informuje sport-tour.pl.

To właśnie ta cecha sprawiła, że projekt szybko zwrócił uwagę osób zajmujących się generatywnym wideo, montażem oraz narzędziami AI do obróbki obrazu. Netflix sugeruje tym samym, że przyszłość edycji wideo nie będzie polegała wyłącznie na kosmetycznym retuszu, lecz na inteligentnym przetwarzaniu całych zdarzeń widocznych w kadrze.

To już nie jest zwykłe usuwanie elementów z obrazu, lecz próba stworzenia alternatywnej wersji tej samej sceny.

Czym jest VOID i dlaczego wzbudził tyle zainteresowania

Nazwa VOID pochodzi od angielskiego Video Object and Interaction Deletion. To framework do usuwania obiektów z wideo, który — według opisu twórców — łączy model vision-language z dyfuzyjnym modelem wideo, aby generować bardziej naturalne i fizycznie wiarygodne rezultaty.

Największą różnicą względem wielu dotychczasowych rozwiązań jest to, że VOID bierze pod uwagę nie tylko sam obiekt, ale także jego wpływ na otoczenie. Jeżeli więc ze sceny zostanie usunięta osoba trzymająca jakiś przedmiot, model powinien odtworzyć nagranie tak, by ten przedmiot zachowywał się logicznie — na przykład spadł, zamiast nienaturalnie wisieć w powietrzu.

W praktyce oznacza to, że AI nie tylko „czyści” obraz, ale próbuje zrozumieć, co naprawdę zmieniłoby się w scenie po zniknięciu danego elementu.

Twórcy projektu wskazują, że system opiera się na rozumowaniu przyczynowo-skutkowym i kontrfaktycznym. Dzięki temu model nie ogranicza się do uzupełniania tła, lecz analizuje, które części sceny były związane z usuniętym obiektem i także wymagają korekty.

Jak działa model VOID w praktyce

Netflix just open-sourced VOID

— 0xMarioNawfal (@RoundtableSpace) April 3, 2026

A model that removes objects from video along with every physical interaction they caused.

Remove a person holding a guitar and the guitar falls naturally. Remove hands and the objects they were touching react accordingly. pic.twitter.com/Cp54aEiVy7

Proces zaczyna się od wskazania obiektu, który ma zostać usunięty z nagrania. Następnie system identyfikuje obszary wideo, które pozostają z nim w relacji przyczynowej lub wizualnej. Na tej podstawie powstaje tzw. quadmask, czyli specjalna maska obejmująca kilka typów stref: sam obiekt, obszary nakładania się, miejsca wtórnych interakcji oraz tło.

Dopiero po takim rozpoznaniu model generuje nową wersję sceny. Co ważne, VOID działa dwuetapowo. Pierwszy etap odpowiada za podstawowe usunięcie obiektu i odbudowę obrazu, a drugi służy do poprawy spójności czasowej, szczególnie w dłuższych klipach, gdzie łatwo o niestabilność ruchu lub drobne deformacje.

Najważniejsze możliwości VOID

- usuwanie obiektów z wideo z uwzględnieniem ich wpływu na scenę,

- korekta nie tylko tła, ale także powiązanych ruchów i interakcji,

- obsługa bardziej złożonych sytuacji, takich jak upadki, kolizje czy zmiana trajektorii,

- dwuetapowe przetwarzanie poprawiające stabilność końcowego efektu,

- publiczny dostęp do modelu, kodu, demo oraz pracy naukowej.

Właśnie tutaj przebiega granica między prostym retuszem a naprawdę inteligentną edycją wideo.

Czym VOID różni się od zwykłego video inpaintingu

Większość klasycznych narzędzi do usuwania obiektów z wideo radzi sobie głównie z tym, co znajduje się bezpośrednio za danym elementem. Mogą one odtworzyć fragment tła, wygładzić kontury czy usunąć cień, ale mają problem, gdy usunięty obiekt realnie wpływał na zachowanie innych elementów w kadrze.

To właśnie ten problem VOID próbuje rozwiązać. Jeśli na przykład człowiek podtrzymuje jakiś przedmiot, klasyczny system może usunąć postać, ale pozostawić sam przedmiot w nienaturalnej pozycji. VOID ma ambicję przebudować całą sytuację tak, by wynik wyglądał spójnie i naturalnie.

Porównanie podejść

| Rozwiązanie | Jak działa | Główne ograniczenie |

|---|---|---|

| Klasyczny video inpainting | Uzupełnia tło po usuniętym obiekcie | Słabo radzi sobie z interakcjami i fizyką |

| VOID | Usuwa obiekt i rekonstruuje skutki jego obecności | Wymaga dużej mocy obliczeniowej |

Takie podejście może mieć duże znaczenie w reklamie, materiałach promocyjnych, produkcji contentu do mediów społecznościowych czy w kreatywnym montażu, gdzie nawet drobny błąd w ruchu natychmiast rzuca się w oczy.

Co wiadomo o parametrach technicznych

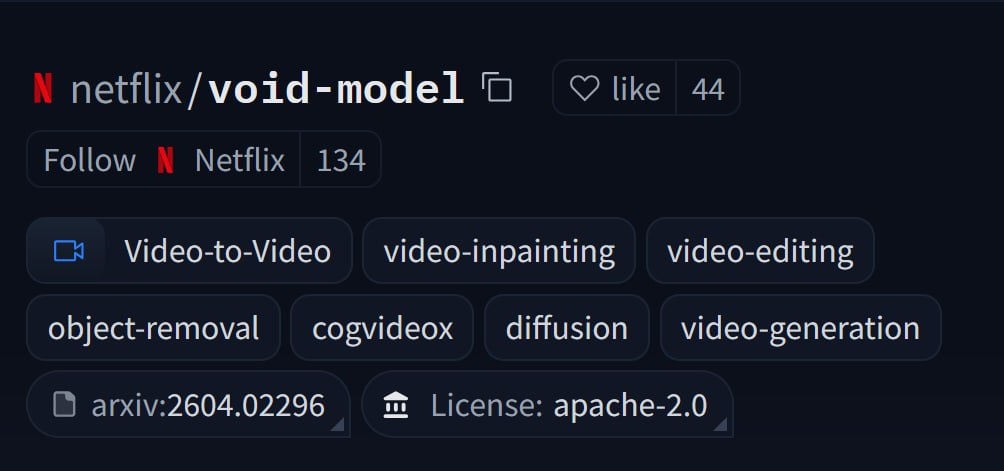

Netflix udostępnił model na Hugging Face, a kod źródłowy na GitHubie. Z opisu wynika, że VOID został zbudowany na bazie CogVideoX-Fun-V1.5-5b-InP, obsługuje bazową rozdzielczość 384×672, wspiera nagrania do 197 klatek i wykorzystuje BF16 wraz z FP8-kwantyzacją dla efektywniejszego wykorzystania pamięci.

Twórcy zwracają też uwagę, że szybkie uruchomienie modelu wymaga bardzo mocnego GPU — mowa o konfiguracjach z 40 GB VRAM lub więcej, takich jak A100. Oznacza to, że na razie nie jest to rozwiązanie typowo konsumenckie dla zwykłego laptopa, lecz raczej narzędzie badawcze i profesjonalne.

Szybki przegląd VOID

| Parametr | Informacja |

|---|---|

| Nazwa | VOID — Video Object and Interaction Deletion |

| Twórca | Netflix |

| Zastosowanie | Usuwanie obiektów z wideo z uwzględnieniem interakcji |

| Baza modelu | CogVideoX-Fun-V1.5-5b-InP |

| Dostępność | Hugging Face, GitHub, demo, paper |

| Licencja | Apache-2.0 |

| Wymagania sprzętowe | GPU z 40 GB+ VRAM |

| Dodatkowy etap | Pass 2 dla lepszej stabilności czasowej |

Gdzie VOID może znaleźć zastosowanie

Choć projekt ma wyraźnie technologiczny charakter, jego potencjalne zastosowania są bardzo praktyczne. Tego typu model może być przydatny wszędzie tam, gdzie liczy się szybka i wiarygodna edycja obrazu ruchomego.

Przykładowe zastosowania

- czyszczenie kadru z niepotrzebnych elementów w reklamach i prezentacjach produktów,

- poprawa materiałów wideo do social mediów bez ręcznego compositingu,

- przygotowywanie trailerów i materiałów promocyjnych,

- rozwój nowych narzędzi do inteligentnego montażu,

- eksperymenty z AI, które nie tylko generuje obraz, ale rozumie jego logikę.

VOID pokazuje kierunek, w którym sztuczna inteligencja przestaje być jedynie narzędziem do „upiększania” obrazu, a zaczyna ingerować w sam przebieg zdarzeń widocznych w wideo.

Czy to początek nowego etapu w edycji wideo AI

Wszystko wskazuje na to, że Netflix chce zaznaczyć swoją obecność w segmencie, w którym liczy się nie tylko estetyka, ale przede wszystkim wiarygodność po edycji. To ważny sygnał dla całego rynku generatywnego wideo.

Coraz wyraźniej widać, że kolejnym etapem rozwoju tego sektora będzie nie tylko poprawa jakości wygenerowanych klatek, ale przede wszystkim zdolność modeli do rozumienia zależności, interakcji i podstawowych zasad fizyki w scenie. VOID dobrze wpisuje się w ten trend.

Na ten moment projekt wygląda bardziej jak mocna demonstracja technologiczna i inżynieryjna niż masowe narzędzie dla każdego użytkownika. Mimo to już sam fakt, że Netflix upublicznił model, kod, demo i dokumentację, sprawia, że VOID staje się jednym z najciekawszych projektów AI w obszarze edycji wideo.

Jeśli ten kierunek się utrzyma, w najbliższych miesiącach możemy zobaczyć coraz więcej narzędzi, które nie tylko usuwają obiekty z nagrań, ale wręcz przepisują logikę całych scen.

Więcej emocji wokół technologii i cen sprzętu znajdziesz też w materiale Dlaczego PS5 znowu drożeje? Sony podnosi ceny konsol i gracze mają powody do niepokoju.